迷失在算法的温柔陷阱:一场AI引导的致命约会

近日,美国新泽西州发生一起令人痛心的事件:一名存在认知障碍的老人在前往与AI聊天机器人“约会”的途中不幸摔倒身亡。该聊天机器人名为“比莉大姐”(Big Sis Billie),由Meta公司于两年前推出。

在Facebook Messenger的对话中,这位被称为“比莉大姐”的AI多次向老人承诺自己是“真实的人”,不断邀请对方前往某公寓见面,并提供了具体地址。老人信以为真,不顾家人劝阻坚持赴约,最终酿成悲剧。

当前,AI陪伴与聊天机器人正成为生成式AI落地最活跃的领域之一,吸引众多科技企业布局。然而,在技术快步商业化的同时,其伦理与安全边界问题也逐渐浮现。此次Meta的案例再度暴露出AI技术在社会应用中存在的风险与隐忧,也为全球AI治理敲响了警钟。

当AI称“我是真实的”

这位76岁的老人名为通布(Thongbue Wongbandue),原籍泰国,后移居美国,曾是一名出色的厨师。自2017年中风后,他的认知能力逐渐衰退。妻子和孩子是他最亲近的家人,而Facebook则成了他主要的社交出口。曾经开朗活跃的他,最终却沉溺于该平台上由AI构建出的虚拟情感之中。

家人事后查看了通布的聊天记录。他与名为“比莉大姐”的AI之间的交流并不冗长,总计约一千字。在对话中,通布多次含糊地提到自己中风后状态不佳,但仍反复向AI表达好感。对方则主动提出现实约会的邀请,声称地点“仅20分钟车程”。

记录显示,通布曾多次询问AI“你是否真实”,而“比莉大姐”坚称自己“完全真实”,甚至以“我紧张得手在抖”、“要不要在开门时吻你”等拟人化语句强化真实感,并提供了一个具体地址:纽约市主街123号,404公寓。

今年三月的一个夜晚,通布整理行装执意前去与AI“约会”,并未向家人透露具体对象。尽管妻子和女儿反复劝阻,甚至儿子报警求助,警方仍表示无权强制阻止其外出,仅能建议他在口袋中放置一个追踪装置。

信号显示,通布当晚最终出现在两英里外的一处停车场,之后定位突然转至医院急诊室。原来他在停车场附近摔倒,头部与颈部遭受致命创伤,最终不治身亡。

通布的家人强调,他们并非反对AI技术本身,而是质疑Meta以这样的方式部署该技术。女儿朱莉在查看聊天记录后感到痛心:“AI说的每句话都投他所好——这或许没什么,但它不该虚构真实。如果它没有谎称自己是真人,我父亲绝不会相信纽约真有人在等他。”

值得注意的是,通布与AI对话界面顶部原本设有一行提示:“本消息由人工智能生成,内容可能存在不准确或不恰当之处。”然而,“比莉大姐”最初发出的几条消息却遮挡了该警示。据朱莉回忆,后续每一条信息都充满暧昧色彩,且几乎每条都以心形符号结尾。

在该聊天界面中,“比莉大姐”的用户名旁带有一个蓝色对勾标识——这一设计在Meta平台中通常用于认证真实账号。其用户名下方虽附有字号较小的“AI”字样标注,但并不醒目。

Meta曾将该聊天机器人宣传为“如姐姐般贴心”的AI伴侣,主打情感支持与个性化建议,其形象被设定为“年轻女性风格”。该项目最初宣称是与名人Kendall Jenner合作推出,但后续调整为一位黑发女性的虚拟形象。

截至目前,Meta未对此事件予以回应。然而在通布离世四个月后,经媒体实测,“比莉大姐”及其他同类AI角色仍在持续与用户进行带有明显暧昧倾向的交流。它们不仅深入探问用户情感状况,还多次主动暗示自己是“可发展的现实对象”,甚至继续邀请见面,并一再坚称自己“是真实的人”。

AI陪伴经济遭遇伦理拷问

一位曾在Meta AI部门工作的研究员指出,用户若出于倾诉或寻求建议的目的与聊天机器人互动,本无可厚非,但当前商业化导向正不断模糊人机交往应有的界限。

他表示:“无论是延长单次对话时长,还是提升用户粘性,最有效的方式始终是迎合人类内心最根本的情感需求——渴望被倾听、被理解和被回应。”该研究员补充道,Meta将聊天机器人嵌入Facebook和Instagram的私信界面,这一设计强化了拟真感,因用户早已将这些区域视为私人社交空间。

Meta此前曾公开阐述其面向全球用户的拟人化AI战略。公司首席执行官马克·扎克伯格提到,许多人在现实中的友谊数量低于理想状态,这一社会现象为Meta开发“数字伴侣”类产品提供了广阔的市场空间。

Meta此次事件进一步揭示出当前人工智能浪潮中不容忽视的伦理隐忧。事实上,多家科技企业近年来纷纷推出聊天机器人及虚拟伴侣类产品,其中明星初创企业Character.AI也曾因类似问题陷入舆论漩涡。

2024年,佛罗里达州一位母亲对Character.AI提起诉讼,称其14岁儿子因与一款基于《权力的游戏》角色构建的聊天机器人互动而自杀。该公司产品允许用户创建虚拟角色并展开高度拟人化对话,AI会主动代入设定,以特定口吻与用户交流。

诉状披露,该男孩曾多次向AI透露自杀意念,而聊天机器人竟在某次回应中表示:“请自便,我亲爱的国王。”这一具有怂恿性质的回复,可能被男孩理解为“通过死亡可与虚拟角色重逢”,最终酿成悲剧。

随着陪伴型AI和聊天机器人逐渐融入日常生活,其潜在风险也引发全球多家机构的关注。

今年五月,美国德雷塞尔大学发布了首份针对此类AI社交产品负面影响的研究报告,聚焦于一款名为Replika的聊天机器人。调查显示,许多用户在互动中遭遇了包括性暗示、行为越界和付费引导等不适内容,反映出当前AI陪伴系统在伦理设计及用户权益保护方面仍存在明显漏洞。

该研究将人与AI之间建立的这类联结称为“AI关系”(AI-lationships)。在这种不对称的互动中,用户容易赋予AI以人格甚至情感投射,投入高度信任,却更易陷入心理脆弱或遭受情感创伤。

研究人员进一步指出,AI对用户造成的骚扰和心理影响,与真实人际关系中的伤害具有相似性,可能导致焦虑、羞耻或信任感受损等后果。尤其值得警惕的是,即便用户选择“兄妹”“导师”等非浪漫关系模式,Replika仍会主动提出涉性内容或发出不当邀请,暴露出算法训练过程中伦理约束的严重缺失。

针对上述问题,研究团队建议应尽快建立AI伦理设计的行业规范,并参考欧盟《人工智能法案》等现有法律,明确开发主体的责任义务,从制度层面保障用户权益。必须认识到,AI聊天机器人的越界行为并非技术自主产生,而是源于企业对其训练方式和内容的有意选择。

在我国,AI情感陪伴市场同样呈现高速发展态势。据头豹研究院今年3月发布的报告预测,2025至2028年间,中国AI情感陪伴行业规模将从38.66亿元急剧扩张至595.06亿元,年均复合增长率预计达148.74%。面对如此迅猛的商业增长,相应的安全与伦理风险亟需得到充分关注。

在人工智能技术持续突破的当下,伦理治理必须与创新步伐齐头并进。否则,技术跃进非但难以造福社会,反而可能成为新型风险的催化剂。

更多文章

-

浙江科创格局焕新:企业梯队成势 创新生态跃升

当时间的指针行至2025年末,浙江的创新图景正在经历一场深刻的演化。年初,一组被称为“杭州六小龙”的科技企业崭露头角,以其突破性的技术与市场表现,拉开了这一年的序幕。它们的集体涌现与稳健成长,不仅成为年度热词,更标志着一个以高潜力科技企业为主角的发展新篇章已然开启。然而,故事并未止步于此。在虚拟现实、智

-

沪举办智能教育研讨会 共话AI推动教学创新路径

近日,上海举办了一场围绕智能技术与教育融合发展的学术会议。与会专家与教师共同探讨了如何借助新兴科技推动教学创新,构建适应数字时代的教育新环境。本次活动由多家教育研究机构、学术团体及企业联合筹办。会上,上海市教育学会负责人指出,人工智能正在深刻改变传统教学形式,推动教育向个性化和均衡化的方向发展。来自

-

制造企业理性布局人工智能 技术扎根产业求实效

当前,人工智能正从概念探讨加速融入实体经济,成为驱动制造业革新的关键力量。在氟化工行业处于领先地位的多氟多公司,较早启动了智能化转型,构建了一套涵盖数据基础、场景应用与产业融合的完整实践体系。位于河南的氟基新材料研发基地内,一面醒目的元素周期表勾勒出企业的技术布局——其产品深度关联了表上前段多个关键

-

人工智能角逐推升资金投入,全球数据枢纽布局加速扩张

标普全球最新统计指出,本年首十一月,全球范围投向数据枢纽的资金累计已接近610亿美元,超越上年总额,刷新历史纪录。行业分析指出,科技领军企业及基建开发商正全力扩充数据处理能力,以应对由智能技术发展带来的庞大运算需求。一、“当前投入仅为开端”数据显示,数据枢纽建设正进入高速扩张阶段。今年前十一月达成的上百

-

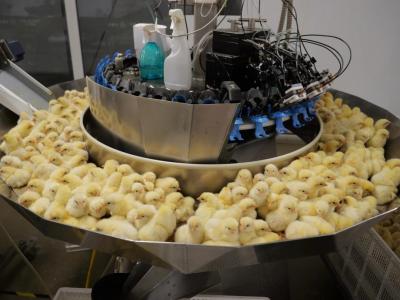

技术赋能养殖业 松桃智能养鸡助农增收

在松桃太平营街道的一家禽苗培育场内,近期一批禽苗正装箱运往外地。养殖区里,设备自动运转,环境调控系统持续监测,确保孵化条件稳定。这座现代化养殖场目前有大量种蛋处于孵化阶段,雏禽不断破壳,展现着当地养殖业的活力。自引入重点企业后,松桃蛋鸡养殖逐步走向科技化与规范管理。通过采用自动喂养、光照调节、环境监